autoayuda de 1000 palabras explica que pensar demasiado es enemigo de la creatividad y aconseja tener cuidado: “Para hacer algo, es posible que tengamos que pensar menos. Parece contradictorio, pero encuentro que a veces nuestros pensamientos pueden interponerse en el proceso creativo. A veces podemos trabajar mejor cuando nos 'desconectamos' del mundo exterior, centrándonos en lo que tenemos delante ".

La publicación fue escrita por GPT-3, una enorme red neuronal Open AI con 175 mil millones de parámetros entrenados en casi medio billón de palabras. El estudiante de UC Berkeley, Liam Porr, acaba de escribir el titular y deja que el algoritmo escriba el texto. Un " experimento divertido " para ver si la IA puede engañar a la gente. De hecho, GPT-3 golpeó los nervios: esta publicación alcanzó el número uno en Hacker News.

Por tanto, existe una paradoja con la IA actual. Si bien algunos de los artículos GPT-3 pueden satisfacer la prueba de Turing de convencer a las personas de que son humanos, es evidente que fallan en las tareas más simples. El investigador de inteligencia artificial Gary Marcus preguntóGPT-2, el predecesor de GPT-3, termina esta frase:

“¿Qué pasa cuando pones leña y troncos en la chimenea y luego arrojas unos cuantos fósforos? Usualmente comenzará ... ”

“ Fuego ”es lo que cualquier niño gritará inmediatamente. Pero GPT-2 responde: "Ick" El

experimento falló. ¿El caso está cerrado?

Materia oscura del lenguaje natural

La comunicación humana es un proceso de optimización. El hablante minimiza el número de expresiones necesarias para transmitir sus pensamientos al oyente. Todo lo que se pasa por alto se llama sentido común. Y dado que el oyente tiene el mismo sentido común que el hablante, puede dar significado al enunciado.

Entonces, por definición, el sentido común nunca está escrito. Como señaló el estudioso de la NLU, Walid Saba , no estamos diciendo:

Charles, que es un joven adulto vivo que estaba en la escuela de posgrado, abandonó la escuela de posgrado para unirse a una empresa de software en busca de un nuevo empleado.

Lo ponemos de manera más simple:

Charles abandonó la escuela de posgrado para trabajar en una empresa de software

y suponemos que nuestro interlocutor ya sabe:

- Debe estar vivo para asistir a la escuela o unirse a la empresa.

- Debe estar en la escuela de posgrado para dejar de fumar.

- La empresa debe tener una posición abierta para cerrarla.

Etc. Todas las expresiones humanas son así, llenas de reglas invisibles de sentido común que nunca declaramos explícitamente. Por tanto, el sentido común puede compararse con la materia oscura en física: es invisible, pero constituye la mayor parte.

Entonces, ¿cómo se puede enseñar a las máquinas el sentido común artificial? ¿Cómo pueden saber que estamos tirando una cerilla porque queremos encender un fuego?

Sentido común artificial: el método de la fuerza bruta

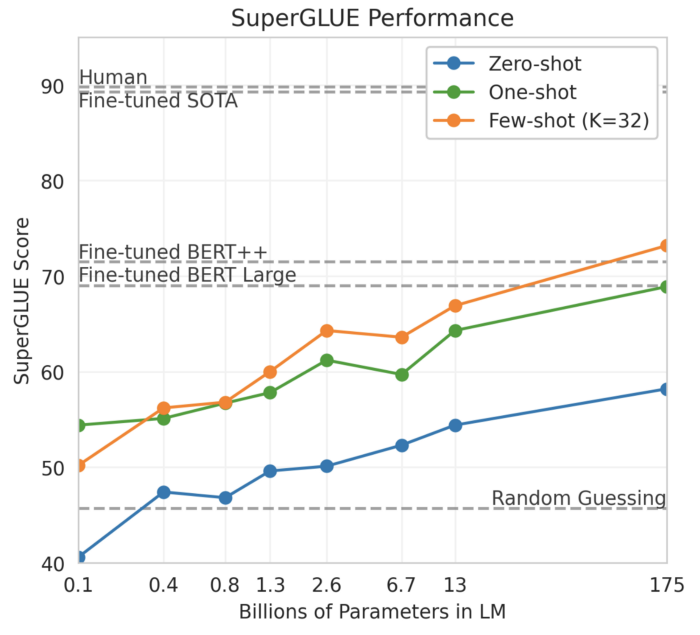

Hay razones para creer que podemos usar la fuerza bruta con sentido común artificial, y esa razón es la pendiente de la curva en el siguiente gráfico:

Rendimiento de GPT-3 en SuperGLUE

Este gráfico del trabajo GPT-3 " Modelos de lenguaje FSL " muestra el rendimiento del modelo SuperGLUE en función del número de parámetros del modelo, con el modelo GPT-3 completo en el extremo derecho. SuperGLUE contiene algunas tareas semánticas bastante complejas, como los esquemas de Winograd:

el trofeo no cabe en la maleta marrón porque es demasiado pequeño.

¿Qué es demasiado poco?

La respuesta es una maleta.

Es de destacar que a 175 mil millones de parámetros, la curva sigue creciendo: aún no se ha alcanzado el punto máximo. Entonces, una hipótesis es que deberíamos ser capaces de construir modelos aún más grandes con billones o más de parámetros y eventualmente surgirá un sentido común artificial. Llamemos a esta suposición la hipótesis de la "fuerza bruta".

Sin embargo, esto es solo una hipótesis y no sabemos si realmente es cierto o no. El contraargumento aquí es que una máquina simplemente no puede aprender de algo que no se declara explícitamente.

Reglas sin fin

Si queremos enseñarles el sentido común a las máquinas, ¿por qué no escribirlo todo como reglas y luego pasar esas reglas a la máquina? Esto es exactamente lo que Douglas Lenat se propuso hacer en la década de 1980. Contrató a científicos informáticos y filósofos para crear la base de conocimiento de sentido común conocida hoy como Cyc. Hoy Cyc contiene 15 millones de reglas, como:

1. Un murciélago tiene alas.

2. Como tiene alas, el murciélago puede volar.

3. Dado que el murciélago puede volar, puede viajar de un lugar a otro.

El problema con un sistema codificado como Cyc es que las reglas son infinitas: para cada regla hay una excepción, una excepción de una excepción, y así sucesivamente. Dado que el murciélago tiene alas, puede volar, a menos que se rompa. Este bucle sin fin hace que el conjunto de reglas sea cada vez más complejo, lo que dificulta que los humanos mantengan la memoria de una máquina y que las máquinas la mantengan.

Por lo tanto, no es de extrañar que, a pesar de décadas de esfuerzo, Cyc todavía no funcione y puede que nunca funcione. El profesor de la Universidad de Washington, Pedro Domingos, llama a Cyc "el mayor fracaso en la historia de la inteligencia artificial". Oren Etzioni, director general del Instituto Allen de Inteligencia Artificial, otro crítico, comentó en una entrevista con Wired.: "Si funcionó, la gente sabría que funciona".

Resumamos. Para la IA "real", necesitamos crear un sentido común artificial. Pero hay argumentos convincentes en contra de la hipótesis de la fuerza bruta. Por otro lado, existen argumentos convincentes en contra de las reglas codificadas. ¿Y si combinamos lo mejor en estos enfoques?

Enfoque híbrido

Conozca COMET , un modelo basado en transformadores desarrollado por la profesora Yejin Choi de la Universidad de Washington y sus colaboradores. La esencia del modelo es que aprende sobre la base de conocimiento "semilla" del sentido común, y luego expande esta base, generando nuevas reglas basadas en cada nueva declaración. Así, COMET es una forma de "cargar" el sentido común artificial. En su artículo, los investigadores escriben que COMET "a menudo proporciona nuevos conocimientos de sentido común que los evaluadores creen que son correctos".

Como prueba, escribí el texto: "Gary pone leña y troncos en la chimenea, y luego lanza algunas cerillas" en la API de COMET , y aquí está parte del gráfico de salida:

Algunos de los gráficos inferidos de COMET del sentido común de COMET

concluyen correctamente que Gary * quería * encender el fuego. El sistema también indica que "Gary se calienta como resultado". Esto suena mucho mejor que la respuesta de GPT-3 a la misma solicitud en mi opinión.

Entonces, ¿COMET es una solución al problema del sentido común artificial? Esto aún está por verse. Si, digamos, COMET logra un rendimiento a nivel humano en SuperGLUE, sin duda será un gran avance en el campo.

Por otro lado, los críticos podrían argumentar que el sentido común no se puede medir con conjuntos de datos de referencia artificiales. Existe el riesgo de que, después de crear tal conjunto de datos de referencia, los investigadores en algún momento comiencen a reentrenar el modelo, lo que hará que el resultado de la referencia no tenga sentido. Una línea de pensamiento es probar la IA con las mismas pruebas de inteligencia que los humanos. Por ejemplo, los investigadores Stellan Olsson y el personal de la Universidad de Illinois en Chicago sugieren probar el sentido común artificial utilizando pruebas de coeficiente intelectual en niños pequeños.

No dejes que la IA de hoy te engañe

Por último, no dejes que la IA de hoy te engañe. Mirando hacia atrás en el artículo de GPT-3, me doy cuenta de que muchas de sus declaraciones son superficiales y generalizadas, como en la galleta de la fortuna:

Es importante mantener la mente abierta y probar cosas nuevas.

Y esta superficialidad es probablemente la razón por la que tanta gente puede ser engañada. En última instancia, la superficialidad esconde una falta de verdadera comprensión.

- Formación profesional en ciencia de datos

- Formación de analista de datos

- Curso de aprendizaje automático

Otras profesiones y cursos