El mundo tecnológico ha adoptado una nueva moda: GPT-3.

Los enormes modelos de lenguaje (como GPT-3) nos sorprenden cada vez más con sus capacidades. Si bien la confianza empresarial en ellos aún no es suficiente para presentarlos a sus clientes, estos modelos demuestran los inicios de la inteligencia que acelerará el desarrollo de la automatización y las capacidades de los sistemas informáticos "inteligentes". Saquemos el aura de misterio de GPT-3 y descubramos cómo aprende y cómo funciona.

El modelo de lenguaje entrenado genera texto. También podemos enviar algún texto a la entrada del modelo y ver cómo cambia la salida. Este último se genera a partir de lo que el modelo ha "aprendido" durante el período de entrenamiento mediante el análisis de grandes cantidades de texto.

El aprendizaje es el proceso de transferir una gran cantidad de texto a un modelo. Para GPT-3, este proceso está completo y todos los experimentos que puede ver se están ejecutando en el modelo ya entrenado. Se estimó que la capacitación tomaría 355 años de GPU (355 años de capacitación en una sola tarjeta gráfica) y costaría $ 4.6 millones.

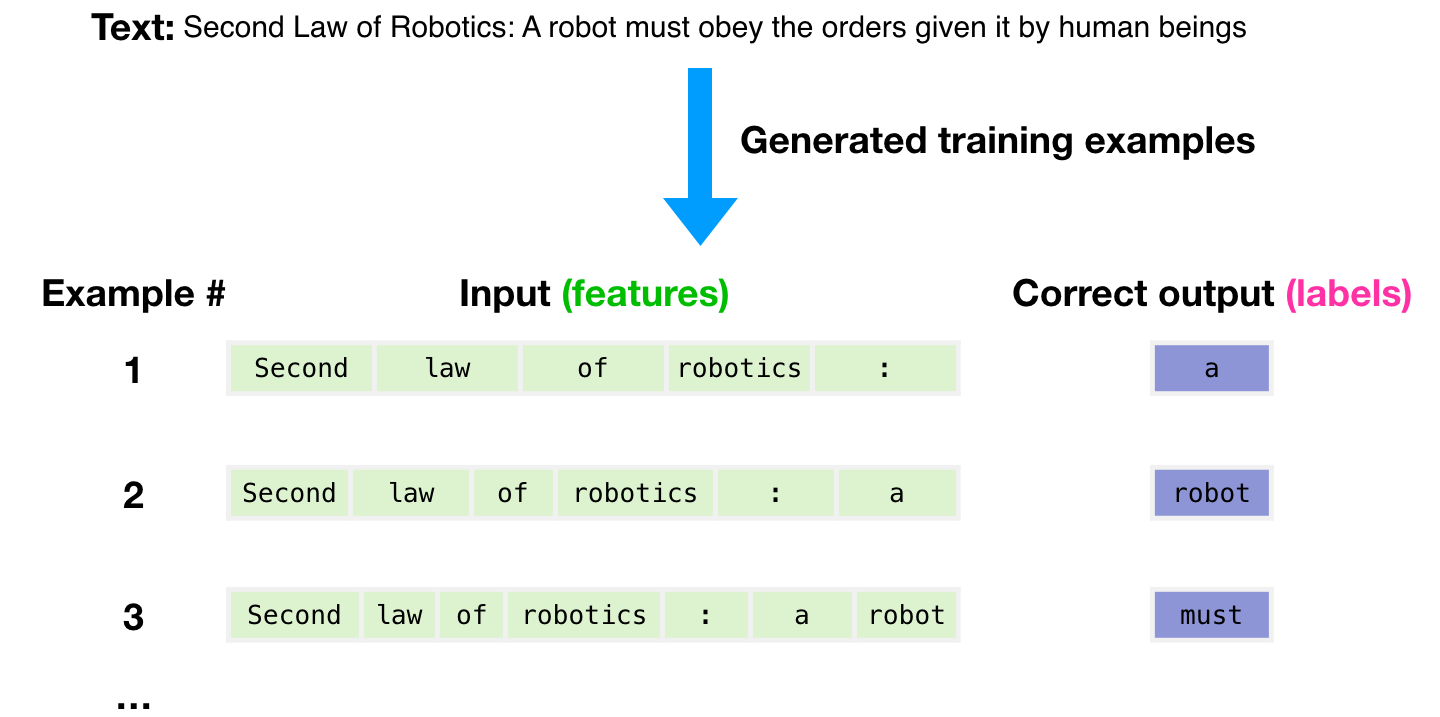

Se utilizó un conjunto de datos de 300 mil millones de tokens de texto para generar ejemplos para entrenar el modelo. Por ejemplo, así es como se ven tres ejemplos de entrenamiento, derivados de una oración anterior.

, , .

( ) .

. , .

.

.

GPT-3 ( , – ).

, — GPT-3, , ( ). – , .

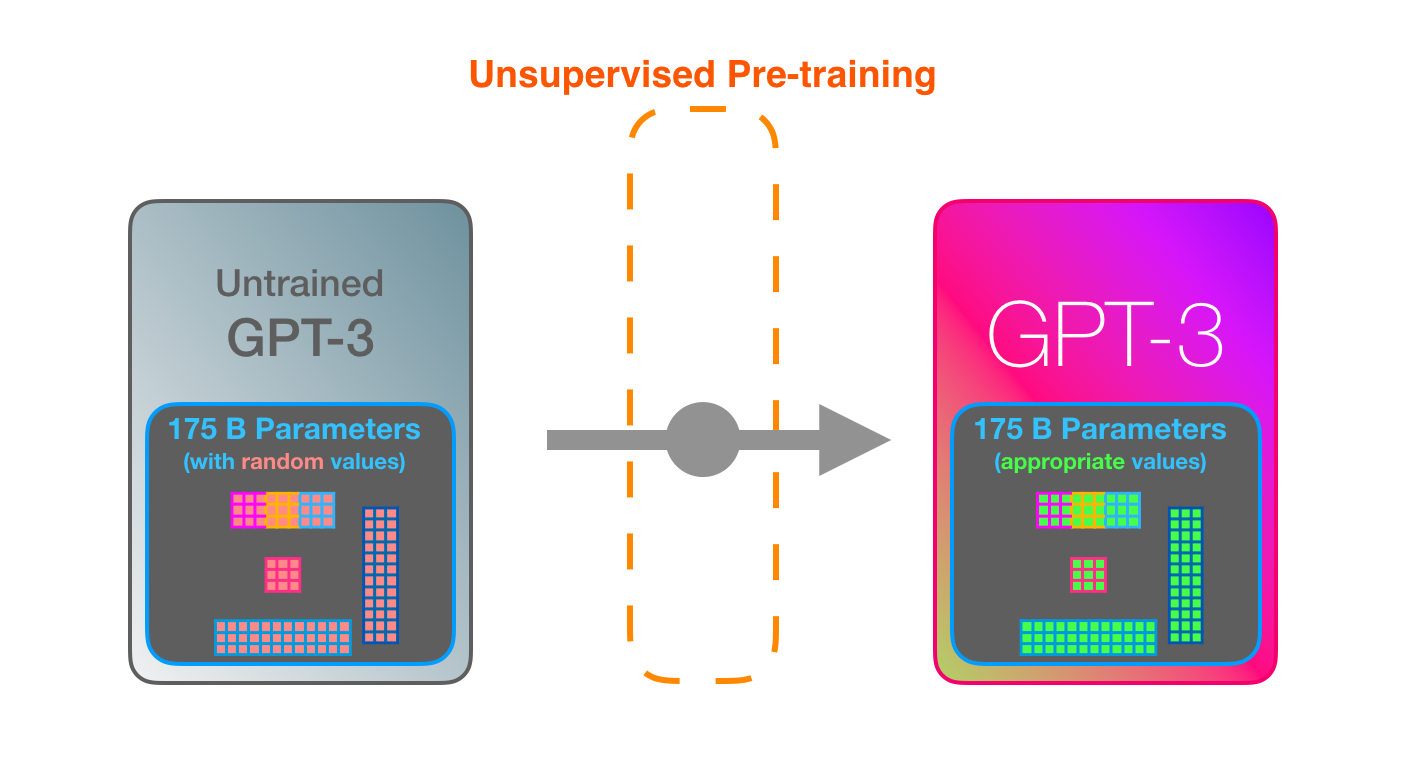

GPT-3 . , , 175 ( ). .

, , .

– , – , .

« Youtube» – 175- .

, , .

GPT-3 2048 – « », 2048 , .

. «robotics» «A»?

:

- ( ).

- .

- .

GPT-3 96 .

? «» « » (deep learning).

1.8 . «». :

, , GTP-2 .

GPT-3 (dense) (sparse) (self-attention).

«Okay human» GPT-3. , . : , . .

React ( ), , => . React , , .

Se puede suponer que los ejemplos y descripciones iniciales se agregaron a la entrada del modelo, junto con tokens especiales que separan los ejemplos del resultado.

La forma en que funciona es impresionante. Solo tiene que esperar a que se complete el ajuste fino de GPT-3. Y las posibilidades serán aún más asombrosas.

El ajuste simplemente actualiza los pesos del modelo para mejorar su rendimiento para una tarea específica.

Autores

- Autor original - Jay Alammar

- Traducción - Ekaterina Smirnova

- Edición y maquetación - Sergey Shkarin